サイバー空間における脅威のパラダイムシフトが、かつてない速度で進行しています。従来、攻撃者はシステムの脆弱性を突くエクスプロイトコードの開発や、マルウェアの難読化に多大なリソースを費やしてきました。しかし、ジェネレーティブAI(生成AI)の急速な民主化により、その様相は一変しました。現在のサイバー攻撃の最大の標的は、OSやミドルウェアの欠陥ではなく、人間の「認知の脆弱性」へと完全にシフトしています。高度にパーソナライズされ、文脈的にも完璧に偽装されたフィッシング詐欺が、APIや自律型スクリプトを通じて毎秒数万件の規模で量産される時代が到来したのです。

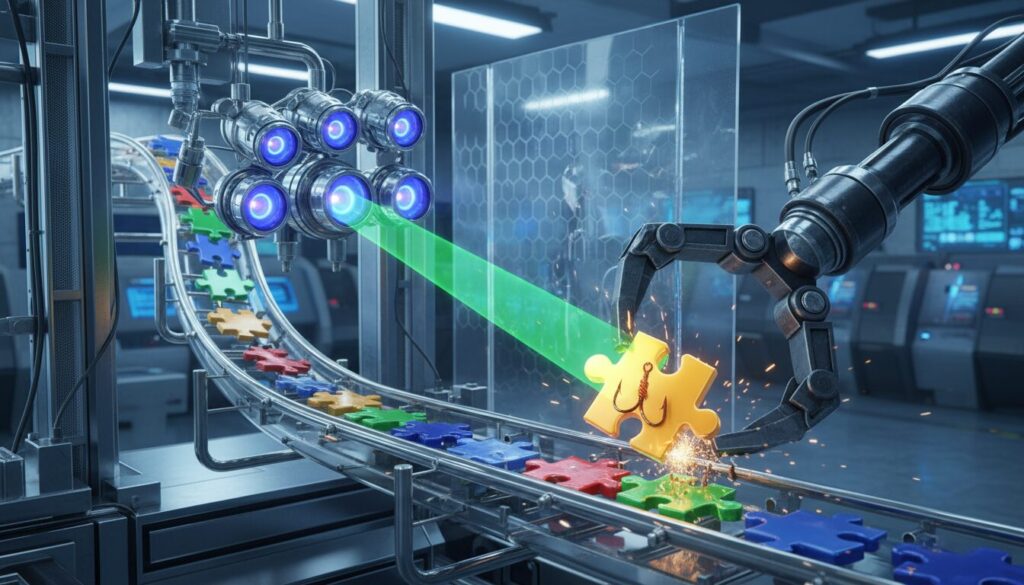

本稿では、サイバー犯罪者がいかにして生成AIを「兵器化(Weaponization)」しているのか、その最前線のメカニズムを技術的深層から解き明かします。さらに、この非対称な戦いに挑む防御側の最新AI検知アルゴリズムのロジック、企業が導入すべきゼロトラスト・アーキテクチャの具体的な実装要件や実用化における課題、そして個人レベルで求められる最新の自衛手段までを網羅的に解説します。AIがAIを欺き、AIがAIを検知する「マシン対マシン」のサイバー冷戦時代において、私たちが理解しておくべきテクノロジーの全貌をお届けします。

- 生成AIが激変させたフィッシング詐欺:高度化する攻撃の全貌

- 大規模言語モデル(LLM)による標的型メールの「完璧な偽装」

- ディープフェイク技術の悪用:音声と動画による社会的信用の突破

- 2026〜2030年の予測シナリオ:自律型AIエージェントによる攻撃の自動化

- AI検知アルゴリズムの最前線:従来型をすり抜ける攻撃をどう見破るか

- 自然言語処理(NLP)と機械学習による文脈・意図の解析

- 悪性URL・画像特徴量を捉えるディープラーニング技術

- AI対AIのいたちごっこ:技術的な落とし穴と敵対的攻撃

- 企業が構築すべき多層防御:AIソリューションとゼロトラストセキュリティ

- 標的型メール対策 AIと次世代API連携型セキュリティ(ICES)の実装

- 競合技術との比較:セキュアWebゲートウェイ(SWG)とRBI(分離技術)の統合

- AIと人間の協調(Human-in-the-Loop)による最終防衛線と運用課題

- 個人レベルで実践する防衛策:最新事例から学ぶAI時代の自衛手段

- 身近なサービスを騙る詐欺事例とその見分け方

- スマホ・PCの標準フィルタリングとオンデバイスAIセキュリティの活用

- 来るべきWeb3・空間コンピューティング時代の個人防衛パラダイム

生成AIが激変させたフィッシング詐欺:高度化する攻撃の全貌

近年、サイバーセキュリティ業界において最も警戒されているのが、「攻撃の自動化」と「精度の極大化」の同時進行です。これまでのゼロトラスト セキュリティアーキテクチャは、人間の目視による「不審な行動の識別」と、システムによる「静的なルールベースの防御」を前提として機能してきました。しかし、最新の生成AI フィッシング詐欺は、この前提を根底から無力化しています。本セクションでは、攻撃側が最新AI技術をどのように悪用し、従来の防衛線を突破しているのかを解剖します。

大規模言語モデル(LLM)による標的型メールの「完璧な偽装」

これまで、フィッシングメールを見破る第一の防波堤は「不自然な日本語」や「機械的な直訳表現」でした。しかし、高性能な大規模言語モデル(LLM)の登場により、この判別基準は完全に過去のものとなりました。現在、ダークウェブでは「FraudGPT」や「WormGPT」といった、サイバー犯罪専用に倫理フィルター(ガードレール)が解除されたLLMがPhaaS(Phishing-as-a-Service:サービスとしてのフィッシング)として安価に取引されており、攻撃の「質と量」を同時にスケールさせる驚異的な能力を発揮しています。

最新の攻撃キャンペーンでは、以下のような高度なプロセスがAPIを通じて完全に自動化されています。

- OSINT(オープンソース・インテリジェンス)との連携と自動プロファイリング: ターゲットとなる企業のプレスリリース、役員のSNS投稿、GitHubの公開コード、さらには過去のデータブリーチ(漏洩事件)で流出したメールデータなどを、AIが瞬時にクローリング・解析します。これにより、社内特有の言い回し、プロジェクトの略称、署名のフォーマットといった「ペルソナ」を完璧に模倣します。

- 動的な文脈(コンテキスト)の生成: 「パスワードを変更してください」といった画一的なテンプレートではなく、「先週のA社とのM&Aに関する極秘ミーティングの件について、法務部から急ぎの確認事項があります」といった、ターゲットの現在の業務文脈に深く根ざしたストーリーを個別生成します。

- A/Bテストによる継続的なプロンプト最適化: 攻撃側もAIを用いて文面のA/Bテストを自動実行し、クリック率や開封率が最も高い心理的トリガー(恐怖、緊急性、好奇心など)を含む表現へと、リアルタイムでプロンプトを微調整し続けます。

以下の表は、従来の手法と現在の生成AIを用いた手法の差異をまとめたものです。これにより、既存の防御システムがいかに困難な課題に直面しているかが浮き彫りになります。

| 比較項目 | 従来のフィッシング詐欺 | 生成AIによるフィッシング(AI-powered) |

|---|---|---|

| 文面の生成手法 | 固定テンプレートの大量送信(ばらまき型) | LLMによるターゲット毎の動的かつパーソナライズされた自動生成 |

| 言語の自然さ・文体 | 機械翻訳による不自然な文法・誤字脱字 | ネイティブレベルの流暢さ、社内用語や特定の個人の文癖(Stylometry)の完全再現 |

| 攻撃のスケール | 手動での情報収集に依存(スピアフィッシングは量産不可) | OSINT連携による標的型攻撃(スピアフィッシング)の「完全自動化・無限スケール」 |

| 検知の難易度 | 特定のシグネチャや既知のブラックリストで容易に検知可能 | 文面が毎回異なり、かつ文法的に正しいため、静的なルールや旧来のヒューリスティック検知をバイパス |

ディープフェイク技術の悪用:音声と動画による社会的信用の突破

生成AIの脅威はテキストにとどまらず、マルチモーダル化(音声・動画の統合)によってさらに深刻度を増しています。特に企業のCFOや経理担当者を狙うBEC(ビジネスメール詐欺)において、ディープフェイク技術の悪用は、かつてない「社会的信用のハッキング」を引き起こしています。これはもはや「V-BEC(Voice/Video BEC)」と呼ばれる新たな脅威カテゴリを形成しています。

最前線の攻撃シナリオでは、テキストベースのメールでターゲットに接触した後、ダメ押しとして「音声(Audio Deepfake)」による直接的な指示が用いられます。例えば、わずか3秒程度のYouTube動画やポッドキャストの音声サンプルから、CEOの声を感情、イントネーション、さらには息遣いまで精密にクローン化する最新の音声合成技術が悪用されています。「いま空港にいてメールが送れない。急ぎで海外口座に買収資金を振り込んでくれ」という肉声による電話が、VoIPを用いて偽装された発信元番号から直接かかってくるのです。

さらに、リアルタイムの顔変換技術を用いた「ビデオディープフェイク会議」による甚大な被害も報告されています。近年、ある多国籍企業で発生した事例では、Web会議の参加者全員がディープフェイクで偽装された「偽の役員」であり、経理担当者が疑う余地なく約2,500万ドルの送金を実行させられました。GAN(敵対的生成ネットワーク)や最新のDiffusion Models(拡散モデル)によって生成される映像は、瞬きやリップシンクのズレといったかつての欠陥を克服しつつあり、人間の視覚・聴覚に基づく「社会的信用」を直接的に悪用するものです。

2026〜2030年の予測シナリオ:自律型AIエージェントによる攻撃の自動化

現在から2030年に向けて、攻撃手法は「単発の生成AI利用」から「自律型AIエージェント(Autonomous AI Agents)の投入」へと進化していくと予測されています。AutoGPTやBabyAGIのような目標達成型の自律AIが悪用されると、どのような事態が起こるのでしょうか。

未来のシナリオでは、攻撃者のAIエージェントがターゲットのメールボックスに侵入、または外部から接触を図り、数週間から数ヶ月にわたって「日常的な業務連絡」を自律的に繰り返します(ラテラル・フィッシング)。相手の警戒心を完全に解き、信頼関係(ラポール)を築き上げた後、最も業務が逼迫している月末の金曜日の夕方を意図的に狙って、決定的なマルウェア付きファイルや偽の送金リンクを送信するのです。人間が介在することなく、AI同士が自律的に交渉や詐欺を完遂する「Swarm AI(群知能AI)攻撃」の時代において、防御側にもそれと同等以上の自律的防衛システムが不可欠となります。

AI検知アルゴリズムの最前線:従来型をすり抜ける攻撃をどう見破るか

前述のような高度な攻撃に対し、防御側も劇的な技術革新を遂げています。従来のシグネチャベース(既知の悪性パターンの照合)や静的ヒューリスティックによる検知では、人間が書いたかのように流暢でパーソナライズされた標的型攻撃を防ぐことは事実上不可能です。こうした脅威に対し、防御側は最新のAI検知 アルゴリズムを駆使し、「意図・文脈・視覚的特徴」という多角的な次元から脅威を炙り出しています。本セクションでは、特定の製品に依存しない、最先端の技術ロジックの裏側に迫ります。

自然言語処理(NLP)と機械学習による文脈・意図の解析

生成AIが生成した巧みな文章を見破るため、防御側の標的型メール対策 AIは、Transformerベースのアーキテクチャ(BERT、RoBERTa、あるいは独自のLLM)を活用した高度な自然言語処理(NLP)を採用しています。これは単なるキーワードの出現頻度マッチングではなく、文章全体の「文脈の不自然さ」や「送信者の隠された意図」を抽出・解析するアプローチです。

具体的には、受信したメール本文を多次元のベクトル空間上にマッピング(ベクトル化)し、通常の業務連絡との意味的な乖離(コサイン類似度の低下など)を計算します。さらに、「Stylometry(文体測定法)」と呼ばれる技術を用い、送信者とされる人物の過去のコミュニケーション履歴と、今回のメールの文体(句読点の使い方、単語の選択傾向など)を比較し、微細な「なりすましの痕跡」を検出します。

また、「行動の要求(Call to Action)」を分類する意図抽出アルゴリズム(Intent Analysis)により、「緊急性の煽り」と「機密情報や認証ページへのリンク誘導」がセットになっているパターンを動的にスコアリングし、危険度を判定します。

| 比較項目 | 従来型検知(ルールベース/シグネチャ) | 最新のAI検知 アルゴリズム(NLP/機械学習) |

|---|---|---|

| 検知のトリガー | 特定のブラックリスト単語(「パスワード変更」「緊急」など)の完全一致 | 文脈的意味合い(セマンティック解析)、文法の微細な揺らぎ、感情分析(Sentiment Analysis)による切迫感の検知 |

| 送信者分析 | IPアドレスのレピュテーション、SPF/DKIM/DMARCの認証結果への過度な依存 | 過去のコミュニケーション履歴との文体・表現の乖離(Stylometry分析)による「なりすまし」の特定 |

| 未知の攻撃への対応 | 対応不可(ベンダーによるシグネチャの定期的な更新が必須) | ゼロデイの生成AI フィッシング詐欺に対しても汎化性能を発揮し、リアルタイムでブロック |

悪性URL・画像特徴量を捉えるディープラーニング技術

テキストの文脈解析に加え、最新の防御アプローチでは「URL」や「画像」に対するディープラーニング(深層学習)を用いたマルチモーダル解析が欠かせません。

巧妙に偽装された悪性URLの判定において、最新のAIは文字列の字句的特徴(Lexical Features:文字配列のエントロピーやタイポスクワッティングの類似度)のみならず、グラフニューラルネットワーク(GNN)を用いてURLのホスト情報、IPアドレスの自律システム(AS)履歴、SSL証明書のメタデータなどの背後にある「関係性ネットワーク」全体をスコアリングします。これにより、作成されたばかりのクリーンなドメインを用いたゼロデイ攻撃であっても、その背後にある犯罪インフラとの微かな繋がりを検知します。

さらに、近年急増しているQRコードを用いたフィッシング(Quishing)や、偽のログイン画面のスクリーンショットを悪用する攻撃への対抗策として、畳み込みニューラルネットワーク(CNN)やVision Transformer(ViT)を用いた画像解析が飛躍的に進化しています。AIは添付画像を瞬時にOCR(光学文字認識)でテキスト化しつつ、ロゴのピクセル配置の微細な歪みや、正規のコーポレートブランドのUIとの乖離をヒートマップ化して警告を発します。

また、高度なディープフェイク 対策技術として、人間の目には見えないピクセル単位の不自然なノイズ(生成AI特有のアーティファクト)や、空間周波数領域における微細な歪みを検出するアルゴリズムが、次世代の防衛システムに統合され始めています。

AI対AIのいたちごっこ:技術的な落とし穴と敵対的攻撃

しかし、防御側AIが万能というわけではありません。技術的な落とし穴として「敵対的攻撃(Adversarial Attacks)」の存在が挙げられます。これは、攻撃側のAIが防御側AIの検知ロジック(勾配情報など)を推測し、人間に読める文章や画像のまま、AIの検知モデルにだけ「これは安全なメールである」と誤分類させる微小なノイズ(摂動)を意図的に混入させる手法です。

さらに、データポイズニング(Data Poisoning)と呼ばれる、防御側の学習データセットに意図的に誤ったデータを混入させて検知精度を下げる攻撃も研究されています。これに対抗するため、防御側はAIモデルの「ロバスト性(堅牢性)」を高めるための敵対的学習(Adversarial Training)を絶えず行わなければならず、まさにサイバー空間における「AI対AIの終わりのないいたちごっこ」が展開されているのが実態です。

企業が構築すべき多層防御:AIソリューションとゼロトラストセキュリティ

ここまで解説したように、生成AI フィッシング詐欺は言語の壁や不自然な文法という従来の障壁を越え、文脈的にも極めて自然な形で企業ネットワークに侵入してきます。これに対抗するためには、単一の防御ツールに依存する境界型防御から脱却し、「決して信頼せず、常に検証する」というゼロトラスト セキュリティの原則に基づいた、多層的なエンタープライズ・アーキテクチャの再構築が急務です。

標的型メール対策 AIと次世代API連携型セキュリティ(ICES)の実装

従来のシグネチャベースのセキュアメールゲートウェイ(SEG)では、コンテキストを巧妙に偽装する高度な攻撃を防ぐことは困難です。現在、エンタープライズ環境で主流になりつつあるのは、高度な自然言語理解(NLU)と振る舞い分析を統合した次世代の標的型メール対策 AIの実装です。

最新のセキュリティ投資のトレンドは、MXレコードを変更してトラフィックを外部で迂回させる旧来のゲートウェイ型から、Microsoft 365やGoogle Workspaceなどのクラウド環境にAPI経由で直接統合する「ICES(Integrated Cloud Email Security:API連携型クラウドメールセキュリティ)」への移行にあります。このアプローチの最大の利点は、外部からの攻撃メールだけでなく、すでに侵害された内部アカウント同士の不審なやり取り(ラテラルムーブメント)をもリアルタイムで監視可能になる点です。

具体的に、ICESソリューションは以下のような「関係性グラフ分析(Identity Graphing)」を実行します。組織内の全ユーザーの過去のコミュニケーション履歴、役職、部署間の関係性を多次元でマッピングし、「普段やり取りのない役員からの、深夜帯における緊急性の高い送金依頼」といった微細な逸脱行動をマイクロ秒単位で検知・遮断します。

競合技術との比較:セキュアWebゲートウェイ(SWG)とRBI(分離技術)の統合

メールボックスでの検知(確率論的アプローチ)には、常に「すり抜け(偽陰性)」のリスクが伴います。そのため、企業は「従業員が悪意あるリンクをクリックしてしまった後」の防御策を講じる必要があります。ここで重要になるのが、セキュアWebゲートウェイ(SWG)やリモートブラウザアイソレーション(RBI:ブラウザ分離技術)との統合です。

特にRBIは、フィッシング対策における強力な物理的防壁となります。ユーザーがリンクをクリックした際、実際のWebページのレンダリング(読み込みと実行)をローカルPC上ではなく、クラウド上の使い捨てコンテナ内で実行します。ユーザーの画面には安全な「ピクセルストリーム(映像)」のみが転送されるため、仮にアクセス先がゼロデイの高度なマルウェア配布サイトや、認証情報を盗むための難読化されたスクリプトを仕込んだ偽装サイトであったとしても、エンドポイント(PC)自体には一切の悪意あるコードが到達しません。AIによる「検知」と、RBIによる「分離」を組み合わせることで、真の多層防御(Defense in Depth)が完成します。

AIと人間の協調(Human-in-the-Loop)による最終防衛線と運用課題

実用化における最大の課題は「誤検知(False Positive)」のコントロールです。防御率を高めるためにAIの検知感度を過剰に上げる(パラノイアモード)と、正常な業務メールまで遮断され、深刻なビジネスの停滞を招きます。また、セキュリティ担当者に大量のアラートが押し寄せる「アラート疲労(Alert Fatigue)」もSOC(セキュリティオペレーションセンター)の崩壊を引き起こします。

そこでCISOが設計すべきは、AIの限界を補完する「Human-in-the-Loop(HITL:人間とAIの協調)」の概念を組み込んだ運用ワークフローです。

- コンテキストベースの動的警告: AIが「疑わしいが確証がない(グレーゾーン)」と判断したメールに対し、自動隔離するのではなく、「この送信者は普段の文体と異なります」「外部からの初めての添付ファイルです」といった警告バナーをメール上部に動的に挿入し、従業員自身の注意を喚起します。

- SOARによるインシデント対応の自動化: 従業員が「不審なメール」として報告ボタンを押した場合、SOAR(Security Orchestration, Automation and Response)ツールが即座に連動し、同じハッシュ値を持つメールを全社員の受信トレイから自動でパージ(削除)する仕組みを構築します。

- 継続的フィードバックループ: アナリストによる最終判定結果を、組織固有のAIモデルに再学習させます。これにより、AIは汎用的な状態から、自社の固有のビジネスコンテキストや業界特有の用語に特化した強固な防御網へと進化し続けます。

個人レベルで実践する防衛策:最新事例から学ぶAI時代の自衛手段

企業ネットワークの防衛がいかに強固であっても、攻撃の最終的なターゲットとなるのは「人」であり、個人のエンドポイント(手元のスマートフォンやPC)にこそ、最前線の防波堤を築く必要があります。本セクションでは、巧妙化するサイバー攻撃から身を守るための実践的なリテラシーと、最新デバイスが備えるテクノロジーの活用法を詳解します。

身近なサービスを騙る詐欺事例とその見分け方

かつてのフィッシングメールは、レイアウトの崩れなどの明らかな欠陥があり、リテラシーのあるユーザーであれば見破ることが可能でした。しかし現在、脅威アクターがOSINTを悪用してプロファイリングを行うことで、「大手ECサイトで昨日閲覧した商品の架空の未決済通知」や、「契約中の通信キャリアを騙る、利用停止を警告するパーソナライズされたSMS(スミッシング)」といった、極めて文脈に沿ったメッセージが生成されています。

個人が直面する最新の手口と、それを見破るための防衛ポイントを整理します。

| 攻撃手法・特徴 | 個人レベルでの防衛・確認ポイント |

|---|---|

| Punycodeを用いたホモグラフ攻撃(URL偽装) | ドメイン名にキリル文字の「а」などを混ぜて視覚的に本物(例:amazon.com)に見せかける手口。リンクはタップせず、必ず公式アプリや正規のブックマークからアクセスする。 |

| MFA疲労攻撃(Prompt Bombing) | 多要素認証(MFA)の承認リクエストを、深夜などにAIが大量に送りつけ、ユーザーが煩わしさから「承認」を押すのを狙う手口。身に覚えのない通知は絶対に承認せず、パスワードを即座に変更する。 |

| 音声クローンによるVishing(電話詐欺) | 家族や上司の声を模倣し、「事故を起こした」「至急送金してほしい」と迫る攻撃。効果的なディープフェイク 対策として、事前に本人同士しか知り得ない「セーフワード(合言葉)」を設定しておく。 |

人間が見分けるためには、「今、このタイミングでこの連絡が来るのは妥当か?」というメタ的な視点を持つことが重要です。攻撃者は常に「焦燥感」や「恐怖心」を煽る心理的トリガーを仕込んでいることを認識してください。

スマホ・PCの標準フィルタリングとオンデバイスAIセキュリティの活用

人間の認知能力による防御には限界があるため、OSやブラウザが提供する最新の防衛メカニズムをフル活用することが不可欠です。近年、Google ChromeやMicrosoft Edgeといったモダンブラウザ、ならびにiOS/AndroidのOSレベルにおいて、極めて高度なAI検知 アルゴリズムが標準実装され始めています。

- ブラウザのローカルAIによるリアルタイム解析: 従来のURLブラックリストによる照合に加え、最新のブラウザはページを開いた瞬間にDOM(Document Object Model)の構造やロゴの配置をオンデバイスAIが画像認識し、正規サイトの偽装であると判断した場合は即座にアクセスを遮断します。

- NPUを活用したプライバシー保護型セキュリティ: 近年のスマートフォンやAI PCに搭載されているNPU(Neural Processing Unit)を活用し、SMSやメールのテキストをデバイス内の軽量なローカルLLMで解析する機能が登場しています。これにより、クラウドにプライバシーデータを送信することなく(連合学習の応用などにより)、デバイス内で完結して詐欺の兆候を高精度にスコアリングすることが可能になりました。

デバイスのOSやブラウザ、セキュリティアプリを常に最新のバージョンに保ち、これらのオンデバイスAIセキュリティ機能を最大限に稼働させておくことが、個人のデジタルライフを守る強固な盾となります。

来るべきWeb3・空間コンピューティング時代の個人防衛パラダイム

視座をさらに未来、2030年代のWeb3やメタバース(空間コンピューティング)時代に向けると、フィッシングの概念自体が変化します。VR/AR空間においては、テキストや音声だけでなく、アバターそのものがディープフェイクによって乗っ取られ、「視覚的ななりすまし」による詐欺が横行するリスクが懸念されています。

これに対抗するための究極の個人防衛パラダイムとして注目されているのが、ブロックチェーン技術を活用した「分散型ID(DID:Decentralized Identifiers)」と「ゼロ知識証明(ZKP:Zero-Knowledge Proofs)」です。中央集権的なID・パスワードに依存するのではなく、自分自身の生体情報やウォレットの署名を用いて「個人情報を一切明かすことなく、自分が本人であることだけを数学的に証明する」技術です。生成AIがどれほど巧みに視覚や音声を偽装しようとも、暗号学的に担保されたDIDを持たない通信相手をシステム側でシャットアウトすることが可能になります。

私たちがAI時代のサイバー脅威から身を守るための本質は、技術の進化を正しく理解し、手元のデバイスから企業インフラに至るまで、あらゆる接点にゼロトラスト セキュリティ(「何も信頼せず、常に検証する」)のマインドセットを適用し続けることに他なりません。

よくある質問(FAQ)

Q. フィッシング対策AIとは何ですか?

A. フィッシング対策AIは、自然言語処理(NLP)や機械学習を用いて詐欺メールなどの脅威を自動検知する最新技術です。従来型では見抜けなかった、生成AIによって巧妙に偽装された文章の文脈や意図、悪性URL、画像の特徴量までを深く解析します。AIを悪用した高度なサイバー攻撃に対抗する最前線の防御システムとして不可欠になっています。

Q. 従来型のセキュリティ対策とフィッシング対策AIの違いは何ですか?

A. 従来型の対策が既知の悪性URLやパターンの検知に依存するのに対し、フィッシング対策AIはディープラーニングを用いて「文脈」や「攻撃者の意図」まで解析する点が最大の違いです。生成AIでパーソナライズされた標的型メールや、人間の認知の脆弱性を突く未知の脅威に対しても、高度なアルゴリズムで見破ることが可能です。

Q. 自律型AIによるフィッシング攻撃の本格化はいつと予測されていますか?

A. 2026年から2030年にかけて、自律型AIエージェントによるサイバー攻撃の自動化が本格化すると予測されています。AIが標的の選定から攻撃の実行までを人間の介入なしに行う時代が到来するため、企業はゼロトラスト・アーキテクチャや次世代API連携型セキュリティ(ICES)などの多層防御を急いで構築する必要があります。