近年、大規模言語モデル(LLM)やマルチモーダル生成AIなど、AIアルゴリズムが指数関数的に巨大化するに伴い、データセンターの消費電力と発熱は物理的かつ経済的な限界点(パワーウォール)に達しつつあります。現在、最先端のAIモデルをトレーニングするためには数万基のハイエンドGPUが昼夜を問わず稼働しており、世界のテックトップ企業でさえ「将来的な電力供給の不足」をAI進化の最大のリスクとして警戒しています。この「電力と熱の壁」を根本から覆す次世代のゲームチェンジャーとして、世界中の半導体エンジニア、R&D担当者、そしてビジョナリー投資家から熱視線を浴びているのがニューロモーフィックチップです。

ニューロモーフィック(神経形態学的)チップとは、人間の脳神経回路の物理的・電気的挙動をシリコン上で直接模倣する、非ノイマン型のプロセッサアーキテクチャを指します。2014年にIBMが発表した画期的なプロトタイプ「TrueNorth」が第一世代のブレイクスルーを牽引して以来、世界中のメガテック企業や研究機関による基礎・応用技術の特許出願数は過去5年で爆発的に増加しました。

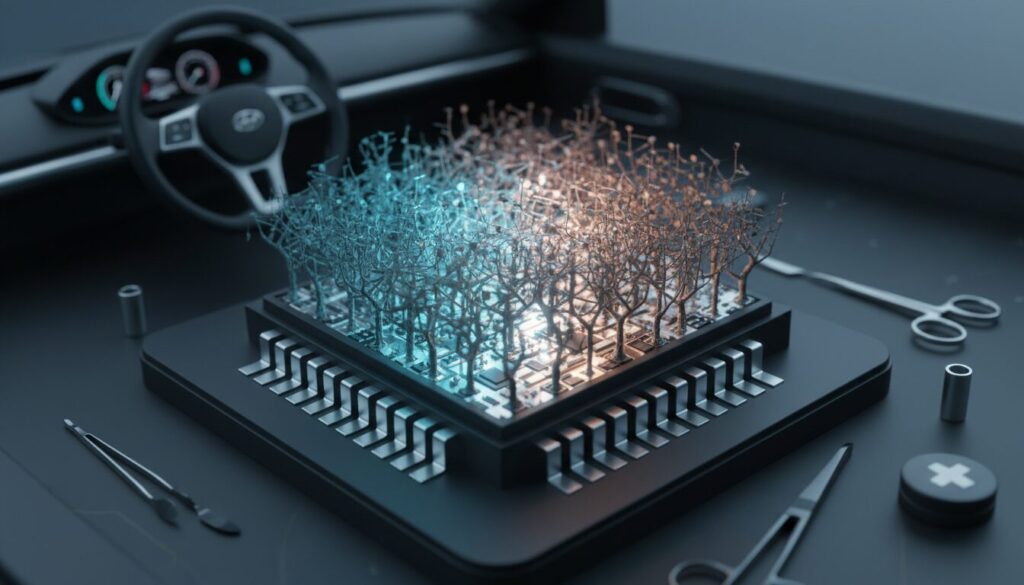

現在では、従来のクラウド通信に依存したAIシステムでは到底クリアできない要件——ミリ秒単位の応答遅延が致命傷となる完全自動運転車、ミリワット級の極小電力で常時稼働が求められるウェアラブル医療デバイス、そしてリアルタイムな自律制御が必須な産業用ロボットなど、過酷な制約が伴うエッジコンピューティング領域において、究極の「省電力AIチップ」としての社会実装が本格的なフェーズへと突入しています。本稿では、この次世代テクノロジーの原理から、競合技術との比較、製造における材料工学的ハードル、そして2030年に向けた市場予測まで、読者が実ビジネスや研究開発の最前線で活用できる深い知見を網羅して解説します。

- ニューロモーフィックチップとは?次世代AIを担う「脳型」アーキテクチャの全貌

- フォン・ノイマン型コンピュータの限界とパラダイムシフト

- 脳のシナプスを模倣する「スパイクニューラルネットワーク(SNN)」

- 既存のAIチップ(GPU・TPU)との決定的な違いとメリット

- 圧倒的な「超低消費電力」とリアルタイム処理の実現

- 競合技術(NPUや光コンピューティング)との比較とポジショニング

- クラウド依存を脱却するエッジコンピューティングへの最適性

- デバイスを支える最新ハードウェア技術と材料工学

- 脳を再現する次世代不揮発性メモリの役割と構造

- 製造プロセスにおける「技術的な落とし穴」と歩留まりの壁

- 【2024年最新】市場動向・特許データと主要プレイヤーの覇権争い

- 巨大テック企業と気鋭スタートアップの開発動向

- 知財戦略と特許出願推移から読み解く地政学的覇権争い

- 社会実装に向けた具体的なユースケースと今後のロードマップ

- 自動運転・IoT・エッジAIが牽引する革新的ユースケース

- 実用化を阻む「ソフトウェア開発環境」の壁とアルゴリズムの課題

- 2026〜2030年の予測シナリオ:エッジからクラウドへの逆還流とAGIへの布石

ニューロモーフィックチップとは?次世代AIを担う「脳型」アーキテクチャの全貌

フォン・ノイマン型コンピュータの限界とパラダイムシフト

現代のあらゆるコンピューティングシステムは、演算装置(CPU/GPU)と記憶装置(メモリ)が物理的に分離されたフォン・ノイマン型アーキテクチャを基盤としています。この構造はプログラムの汎用性を担保する上で極めて優秀ですが、AIのディープラーニングのようにテラバイト級のデータを連続して処理・学習させる際、深刻な構造的欠陥を露呈します。それが、プロセッサとメモリ間のデータ転送速度がシステム全体の性能を律速する「フォン・ノイマン・ボトルネック(メモリウォール問題)」です。

ハードウェア設計の最前線における実測データによれば、DRAMメモリから演算器へデータを転送するためのエネルギー消費は、実際の積和演算(MAC演算)にかかるエネルギーの数百倍から数千倍に達することが知られています。つまり、現在のAIチップが消費する電力の大部分は「計算」ではなく「データの移動」に浪費されているのです。プロセス微細化によるムーアの法則の延命が物理的限界を迎える中、このレイテンシ(遅延)と甚大な熱損失の回避は至上命題となっています。ニューロモーフィックアーキテクチャは、演算と記憶を同一の回路網内で統合的に行う「インメモリコンピューティング(In-Memory Computing)」のアプローチを採用することで、このボトルネックを完全に打破するパラダイムシフトをもたらします。

脳のシナプスを模倣する「スパイクニューラルネットワーク(SNN)」

この革新的な「脳型」ハードウェアの性能を最大限に引き出すソフトウェア的基盤が、第三世代のAIネットワークと呼ばれるスパイクニューラルネットワーク(SNN)です。従来のディープラーニング(CNNやTransformerなど)が連続的な浮動小数点データを用いて、一定のクロック信号に同期して常時計算を行うのに対し、SNNは人間の脳におけるニューロンとシナプスの神経伝達メカニズムを緻密に模倣します。

具体的には、「Leaky Integrate-and-Fire(LIF)モデル」などの数学的モデルを採用し、入力された信号(膜電位)が時間経過とともに蓄積され、一定の閾値を超えた瞬間にのみ「スパイク(パルス信号)」を発火させます。このスパイクには「いつ発火したか」という時間的コーディング(Temporal Coding)の概念が含まれており、情報のスパース性(疎性)を極限まで高めることができます。

この「イベント駆動型」アーキテクチャにより、視覚や聴覚の入力データに変化が発生しない領域での消費電力はほぼゼロ(微小なリーク電流のみ)に抑えられます。無音の部屋にいるときや、目の前の景色に変化がないときに、脳が不要なエネルギーを消費しないのと同じ原理です。この極めて洗練されたエネルギー効率こそが、次世代テクノロジーの新たな地平を切り拓く鍵となっています。

既存のAIチップ(GPU・TPU)との決定的な違いとメリット

圧倒的な「超低消費電力」とリアルタイム処理の実現

現在のAI開発を力強く牽引するGPUやTPUは、膨大な行列演算を並列処理する能力に特化していますが、前述の通りその本質は「連続的なクロック駆動」に依存しています。GPUはシステムクロック信号に同期して常に全回路に電力を供給し続けるため、データがスパース(ほとんどがゼロの疎なデータ)であっても、無駄なゼロ乗算に電力を消費してしまいます。

対照的に、ニューロモーフィックチップはスパイクが発生した(イベントが起きた)回路部分だけが局所的にアクティブになる非同期処理を行います。先行する研究成果において、Intelのニューロモーフィックチップ「Loihi」などは、特定の動的最適化タスクやロボット制御において、従来のGPUと比較して消費電力を数百分の一から数千分の一にまで削減でき、かつ処理速度(レイテンシ)を最大数十倍向上させることが実証されています。この劇的な電力効率の改善は、熱設計電力(TDP)の厳しい制約を大幅に緩和し、冷却ファンなどの排熱機構を持たない極小デバイスへの高度なAI実装を可能にします。

競合技術(NPUや光コンピューティング)との比較とポジショニング

エッジAIの分野では、スマートフォン等に搭載される「NPU(Neural Processing Unit)」も台頭していますが、これらはあくまで既存のCNNなどを効率的に実行するための「フォン・ノイマン型アクセラレータ」であり、アーキテクチャの根本的な壁は越えていません。また、次世代技術として注目される「光(フォトニック)コンピューティング」は、光子を用いた超高速かつ低遅延な演算が可能ですが、現時点ではレーザー光源や光変調器のシリコンチップ上への小型集積に莫大なコストと物理的課題を抱えており、主にデータセンター間通信やクラウド側の用途に留まっています。

ニューロモーフィックチップは、このギャップを埋める存在です。「シリコンベースの超小型化」と「エッジでのマイクロワット〜ミリワット駆動」という両方の要件を同時に満たすことができる唯一のハードウェアとして、明確な優位性とポジショニングを確立しています。

クラウド依存を脱却するエッジコンピューティングへの最適性

圧倒的な省電力性と、データ移動を伴わない低レイテンシは、AIの主戦場をクラウドからデバイス側へと移す「エッジコンピューティング」の概念を根底から覆すポテンシャルを秘めています。現在、高度なAI推論の多くはクラウド上のサーバーに依存していますが、通信によるタイムラグ、常時接続の通信コスト、そして機密データ(工場内の映像や個人の生体情報)を外部に送信するセキュリティリスクが、多くの企業においてDX推進の重大な障壁となっています。

ニューロモーフィックチップは、データが生成される現場(エッジ)での高度かつ即時的な自律処理、さらには「オンチップでのリアルタイム学習(On-device Learning)」を可能にするため、クラウドにデータを上げることなく、環境の変化に適応して自ら賢くなるスマートデバイス群の基盤となるのです。

デバイスを支える最新ハードウェア技術と材料工学

脳を再現する次世代不揮発性メモリの役割と構造

ニューロン間の結合強度を司るシナプスをハードウェア上で物理的に模倣するためには、論理的な回路設計の変更にとどまらず、デバイスレベル(材料工学)での革新が不可欠です。初期のニューロモーフィックチップはSRAM(揮発性メモリ)を用いてデジタル的に脳を再現していましたが、チップ面積の肥大化とリーク電流の増大が足かせとなっていました。

そこで現在、数千億円規模のR&D投資を集めているのが、アナログ的な抵抗値の変化で記憶と演算を同時に行う「次世代不揮発性メモリ(NVM)」群です。オームの法則とキルヒホッフの法則という物理法則そのものを利用して、瞬時に超並列のアナログ積和演算を実行します。主流となっているのは以下の技術です。

- ReRAM(抵抗変化型メモリ) / メンリスタ: 酸化ハフニウム(HfO2)や酸化タンタルなどの絶縁層に電圧をかけ、ナノスケールで酸素空孔を移動させて導電フィラメントを形成・消滅させます。極小面積で多値(アナログ)記憶が可能であり、最も実用化に近いとされています。

- PCM(相変化メモリ): カルコゲナイド・ガラスという特殊な合金を用い、熱によって結晶状態(低抵抗)とアモルファス状態(高抵抗)を遷移させます。長期的なデータ保持特性に優れます。

- MRAM(磁気抵抗メモリ) / スピンメンリスタ: 電子のスピン(磁気)を利用し、磁気トンネル接合(MTJ)の抵抗変化を利用します。エンデュランス(書き換え可能回数)が事実上無限に近いという圧倒的な利点があります。

- FeFET(強誘電体トランジスタ): ゲート絶縁膜に強誘電体を用い、分極状態によって閾値電圧を連続的に変化させます。既存のCMOSプロセスとの親和性が非常に高い点が評価されています。

製造プロセスにおける「技術的な落とし穴」と歩留まりの壁

これらの新素材は理想的な特性を持つ一方で、実社会の産業用途に耐えうる製品として歩留まり良く量産化する道のりには、製造現場レベルでの極めて高いハードル(落とし穴)が存在します。

第一の落とし穴は、「スニークパス電流(回り込み電流)」の問題です。数百万個のシナプス素子をクロスバーアレイと呼ばれる格子状に高密度配置すると、目的の素子以外にも電流が漏れ出してしまい、読み出し精度が著しく低下します。これを防ぐために、各メモリ素子に非線形な特性を持つ「セレクタ素子」を組み合わせる(1S1R構造、または1T1R構造)必要がありますが、このセレクタの開発自体が高度な技術的障壁となっています。

第二の壁は、シビアな「熱収支(Thermal Budget)」の制約です。ニューロモーフィックチップは、下層に演算用のCMOSロジック回路を形成し、その上の配線層(BEOL工程)にReRAMなどの新素材を積層する3D構造をとります。しかし、下層のトランジスタを熱劣化させないよう、上層のメモリ形成は400℃以下の低温プロセスで行う必要があります。この低温環境下で、新素材の結晶性を高め、各素子の抵抗変化特性のばらつき(Device-to-Device Variation)をAIの許容範囲内に抑え込む成膜・プラズマ技術の確立が、ファウンドリ各社の命運を分けています。

【2024年最新】市場動向・特許データと主要プレイヤーの覇権争い

巨大テック企業と気鋭スタートアップの開発動向

次世代の省電力AIチップを巡る競争は、単なる基礎研究の域を脱し、商用化に向けた熾烈なエコシステム構築のフェーズへと突入しています。巨大テック企業の筆頭であるIBMは、2023年後半から2024年にかけて、既存のAIワークロードとの親和性を飛躍的に高めた次世代アーキテクチャ「NorthPole」を発表しました。これはTrueNorthの思想を受け継ぎつつ、SNNだけでなく従来の推論タスクも超高効率で処理できるハイブリッド型のアプローチをとっています。一方のIntelは、第2世代チップ「Loihi 2」とともに、ソフトウェア開発フレームワーク「Lava」のオープンソース化を推進し、開発者エコシステムの囲い込みを急いでいます。

さらに注目すべきは、特定ドメインに特化して商用化を急ぐディープテック系スタートアップの躍進です。オーストラリアに拠点を置く「BrainChip」は、完全なイベント駆動型のニューラルプロセッサ「Akida」を開発し、すでに自動車メーカー等のエッジAI用途でライセンス提供を開始しています。また、スイス発の「SynSense」は、後述するイベントカメラ(DVS)専用の超低電力処理に特化したチップを開発し、スマートホームやドローン市場で存在感を示しています。学術界からも、英マンチェスター大学の「SpiNNaker」や独ハイデルベルク大学の「BrainScaleS」など、数十億ニューロン規模のシミュレーションを目指す巨大プロジェクトが技術的インサイトを提供し続けています。

知財戦略と特許出願推移から読み解く地政学的覇権争い

アスタミューゼ等のグローバル技術動向調査データによれば、ニューロモーフィック関連の特許出願件数は、2018年以降、年平均成長率(CAGR)30%を超える凄まじい勢いで急増しています。直近の特許データから読み取れるのは、プレイヤーの多様化と国家レベルでの知財覇権争いです。

米国企業(IBM、Intel、Qualcomm等)は、チップアーキテクチャの全体設計や、SNNと既存AIモデル間の変換コンパイラに関する「コア特許・ソフトウェア基盤」を強力に押さえています。対して中国は、監視カメラやスマート家電など特定のエッジデバイス向けの実装技術、あるいは材料工学に基づく新奇デバイス構造(ReRAM等のプロセス技術)の特許を大量に出願し、半導体の国内サプライチェーン自立化という国家戦略(デカップリング)と連動して製造レベルでの優位性確保を狙っています。また、欧州の研究機関は、SNNのアルゴリズム最適化や生体模倣メカニズムの基礎特許において強い存在感を示しています。テック系投資家にとっては、これら特許ポートフォリオの重心を見極めることが、次世代の「ポストNVIDIA」を発掘する最重要指標となっています。

社会実装に向けた具体的なユースケースと今後のロードマップ

自動運転・IoT・エッジAIが牽引する革新的ユースケース

ニューロモーフィックチップが最も劇的なイノベーションをもたらすのは、クラウドへの通信遅延が許されないミッションクリティカルな領域です。その筆頭が、レベル4以上の完全自動運転システムです。

自動運転の分野では現在、従来のフレームベースのカメラ(1秒間に30回や60回、画面全体を撮影する)に代わり、ピクセルごとの「輝度の変化(イベント)」だけをマイクロ秒単位で出力する「イベントカメラ(DVS:Dynamic Vision Sensor)」の導入が進んでいます。このDVSから出力されるスパースなスパイク信号と、ニューロモーフィックチップの相性は抜群です。動いている障害物だけを瞬時に、かつミリワット級の電力で認識・予測できるため、夜間や逆光といった過酷な条件下でも、ミリ秒単位での危険回避システムを自律的に構築できます。

また、スマートファクトリーにおける予知保全では、生産ラインのモーターに取り付けられた数百の音響・振動センサーがデータを常時監視します。異常なノイズが発生した瞬間にのみチップがアクティブになって判定を下すため、データセンターの帯域を圧迫せず、運用コストを大幅に削減します。さらに、ウェアラブル医療デバイスの領域では、心電図や脳波を24時間監視し、不整脈やてんかん発作の予兆をエッジ側でリアルタイム検知する、バッテリー交換が長期間不要なインプラント技術への応用が進んでいます。

実用化を阻む「ソフトウェア開発環境」の壁とアルゴリズムの課題

ハードウェアが驚異的なポテンシャルを持つ一方で、実用化に向けた最大のボトルネック(技術的落とし穴)は「ソフトウェアエコシステムの未成熟」です。現在のディープラーニングの圧倒的な成功は、「誤差逆伝播法(バックプロパゲーション)」による効率的な学習アルゴリズムと、PyTorchなどに代表される洗練されたフレームワークの存在に支えられています。

しかし、SNNが扱う「スパイク(0か1かの離散的なパルス信号)」は、数学的に微分が不可能です。そのため、従来のバックプロパゲーションをそのまま適用して学習させることができません。この課題に対し、現在世界中の研究者が2つのアプローチで激しい競争を繰り広げています。

- サロゲート勾配法(Surrogate Gradient): スパイクの発生関数を微分可能な近似関数に置き換えて、擬似的にバックプロパゲーションを行う手法。既存のディープラーニングモデルをSNNへ高精度に変換(オフライン学習)する際に有効です。

- STDP(Spike-Timing-Dependent Plasticity:スパイクタイミング依存可塑性): 実際の脳内で起きている局所的な学習則です。発火のタイミングの前後に応じてシナプスの結合強度をリアルタイムに更新する手法であり、環境変化に適応する「オンチップ・オンライン学習」を実現する究極のアルゴリズムとして期待されています。

インテルの「Lava」フレームワークなどを筆頭に、こうしたハードとソフトのコデザイン(協調設計)を容易にするオープンソースツールの普及が、社会実装のスピードを決定づけます。

2026〜2030年の予測シナリオ:エッジからクラウドへの逆還流とAGIへの布石

最後に、ニューロモーフィックチップが辿る今後5〜10年のロードマップと予測シナリオを提示します。

2026年〜2028年(エッジへの浸透期):

初期の市場形成は、前述したIoTセンサーノード、ドローン、AR/VRデバイス、イベントカメラ制御といった「超低消費電力が絶対条件」となるエッジ領域から始まります。ここでは、複雑な学習はクラウドで行い、推論だけをSNNに高効率化して実装する「ハイブリッド型運用」が主流となり、専用の小規模コプロセッサとしての搭載が急拡大します。

2028年〜2030年(クラウドへの逆還流と汎用化):

材料工学(次世代不揮発性メモリの歩留まり向上)とソフトウェア(SNN専用のコンパイラと学習アルゴリズム)の壁が突破されると、パラダイムは逆転します。エッジデバイスでの「オンデバイス自律学習」が当たり前になるだけでなく、その圧倒的な電力効率と並列処理能力が再評価され、データセンターの巨大なAI推論サーバー、さらには学習基盤へと「ニューロモーフィック・アーキテクチャの逆輸入」が始まります。従来のGPUクラスタが直面していたパワーウォールを突破するための、メガクラウドベンダーによるニューロモーフィックデータセンターの構築です。

ニューロモーフィックチップは単なる「ニッチな省電力技術」ではありません。それは、既存のフォン・ノイマン型アーキテクチャでは到達し得ない、真の意味での「自律性と適応性」を備えた知能をシリコン上に宿す試みであり、究極的には次世代の汎用人工知能(AGI)を物理的に支えるハードウェア基盤への布石なのです。この数十年に一度のパラダイムシフトを見据えた基礎研究と戦略的投資こそが、次なるテクノロジー覇権を決定づけると言っても過言ではありません。

よくある質問(FAQ)

Q. ニューロモーフィックチップとは何ですか?

A. 人間の脳神経回路の物理的・電気的挙動をシリコン上で直接模倣した「脳型」の次世代AIプロセッサです。従来のノイマン型コンピュータの限界を超える非ノイマン型アーキテクチャを採用しています。AIアルゴリズムの巨大化に伴うデータセンターの深刻な消費電力や発熱の課題を根本から解決する技術として注目されています。

Q. ニューロモーフィックチップとGPUの違いは何ですか?

A. 最大の違いは計算アーキテクチャと消費電力です。GPUが膨大な電力を消費してデータ処理を行うのに対し、ニューロモーフィックチップは脳のシナプスを模倣した構造により、圧倒的な「超低消費電力」と「リアルタイム処理」を実現します。これにより、既存のAIチップが抱える電力と熱の限界(パワーウォール)を克服できます。

Q. ニューロモーフィックチップの用途や実用化はいつですか?

A. ミリ秒単位の応答が必須な完全自動運転車、極小電力で常時稼働するウェアラブル医療デバイス、自律制御が求められる産業用ロボットなどでの実用化が進んでいます。クラウド通信に依存せず端末側で高速処理を行う「エッジコンピューティング」に最適であり、2030年に向けて究極の省電力AIチップとして社会実装が本格化しています。