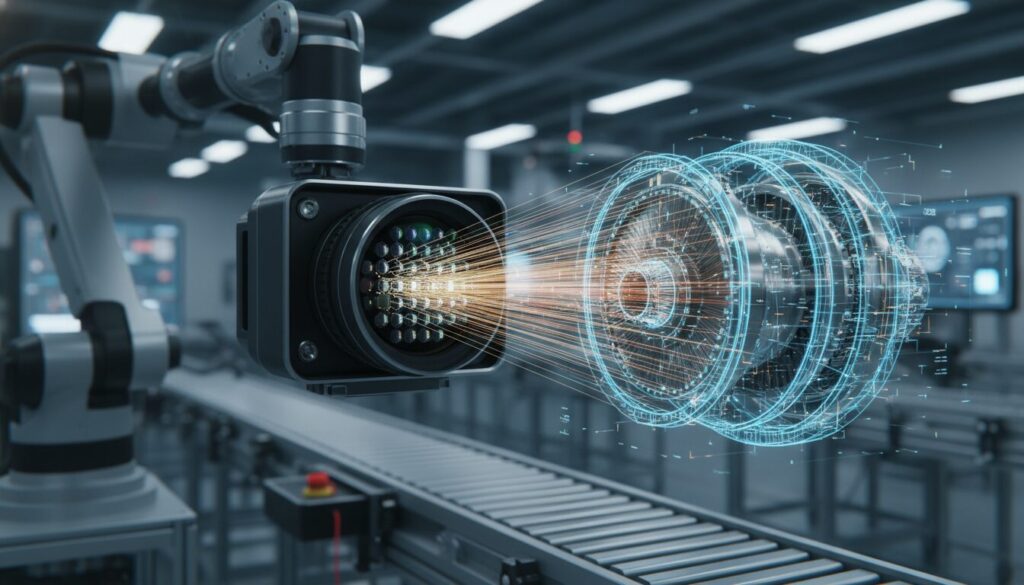

光学技術と情報科学の交差点において、カメラというデバイスの定義そのものを根本から書き換えるパラダイムシフトが進行しています。それが「ライトフィールドカメラ」です。現実世界を単なる2次元の平面として切り取るのではなく、空間を飛び交う光の「ベクトル情報」をサンプリングすることで、撮影後に焦点を自在に操り、一度のシャッターで精緻な3次元空間を再構築する——。この革新的な計算機合成写真術(Computational Photography)は、コンシューマー市場での模索期を経て、現在ではインダストリー4.0を支える最先端の3D計測インフラとして、さらには次世代AI(NeRFや3D Gaussian Splatting等)の空間認識能力を飛躍させる中核デバイスとして確固たる地位を築きつつあります。本記事では、テクノロジー専門メディア「TechShift」の独自視点から、ライトフィールドカメラの基礎理論、最新の市場動向、競合技術との徹底比較、実用化に潜む技術的落とし穴、そして2030年を見据えた未来予測まで、R&D担当者やビジネスリーダーが知るべき全貌を圧倒的な深度で解説します。

- ライトフィールドカメラとは?次世代画像処理を牽引する革新技術

- 従来のカメラとの決定的な違いとリフォーカスの数理的メカニズム

- 空間の光線を捉える「プレノプティック関数」と高度な光学設計

- 競合技術との比較と市場動向の歴史的変遷

- コンシューマー向けから産業特化へのシフト(Lytroの挫折とRaytrixの台頭)

- LiDARやToF、ステレオカメラとの徹底比較

- 国内外の主要プレイヤーとコンポーネントレベルの特許戦略

- 産業界で加速する実用化:3D計測、外観検査、そして極微から流体まで

- 製造業R&Dにおける「ワンショット3D」の圧倒的威力と導入のハードル

- 気流・熱流体解析(PIV)から微小空間の顕微鏡計測まで

- 【TechShift独自考察】最新AI(NeRF/3DGS)との融合が描く未来シナリオ

- 計算機合成写真術と最新AIがもたらすパラダイムシフト

- 2026〜2030年の予測シナリオ:空間コンピューティング時代の中核へ

ライトフィールドカメラとは?次世代画像処理を牽引する革新技術

ライトフィールドカメラは、単なる「新しい撮影機材」ではなく、光学ハードウェアと情報科学のアルゴリズムを融合させた計算機合成写真術の到達点です。従来のカメラが現実世界を不可逆的な2次元の平面に押し込めて記録するのに対し、ライトフィールド技術は空間の光の振る舞いを数理的にキャプチャします。ここでは、次世代の空間コンピューティングを社会実装する上で不可欠となる、光学的および数理的な基礎理論を解き明かします。

従来のカメラとの決定的な違いとリフォーカスの数理的メカニズム

従来のデジタルカメラ(ピンホールカメラモデルに基づくもの)とライトフィールドカメラの最も決定的な違いは、イメージセンサーに到達する光の「何を記録するか」にあります。従来型カメラは、メインレンズを通ってきた光線の束を単一のピクセル上で積算し、「光の強度(明るさ)」と「色」のみを2次元情報として記録します。この積算の過程で、光が「どの角度から飛んできたか」という重要なベクトル情報(方向情報)は完全に消失してしまいます。結果として、撮影時に光学的に決定された焦点面(ピント)や被写界深度は、後から変更不可能なものとなります。

一方、ライトフィールドカメラは、光の強度に加えて「光線の入射方向(角度)」を同時に記録します。この方向情報を保持しているため、撮影後にソフトウェア上で光の軌跡をフーリエスライス定理などの数理的アルゴリズムを用いて逆算し、仮想的な焦点面を任意の位置に再設定することが可能になります。これが、一般に知られるリフォーカス(Refocus)機能のメカニズムです。

しかし、この革新的な機能には「技術的な落とし穴」も存在します。光線の角度情報を保持するためには、従来の2次元画像に比べてデータ量が爆発的に増大します。例えば、1枚のライトフィールド画像を取得するだけで数ギガバイトに達することも珍しくなく、これがストレージやI/O帯域を強烈に圧迫します。さらに、取得した生データ(RAW)からリフォーカス画像や深度マップを生成(現像)するプロセスにおいて、膨大な浮動小数点演算が要求されるため、リアルタイム処理を行うにはハイエンドなGPUリソースが不可欠となります。ライトフィールドカメラの導入を検討するエンジニアは、単なる光学性能だけでなく、後段のコンピューティングアーキテクチャも含めたシステム全体の設計が求められるのです。

空間の光線を捉える「プレノプティック関数」と高度な光学設計

ライトフィールドの概念を数理的に記述する中核がプレノプティック関数(Plenoptic Function)です。本来、空間内のあらゆる光線は、3次元空間の座標(x, y, z)、光線の進行方向(θ, φ)、波長(λ)、時間(t)の7次元関数として定義されます。しかし、特定の瞬間における単一波長の光を考え、光が直進する障害物のない空間(メインレンズからセンサーへの内部空間など)に限定することで、この関数は2つの平行な平面(レンズ面とセンサー面)を通過する交点座標(u, v および x, y)を用いた「4次元の光線空間」へと次元削減されます。ライトフィールドカメラとは、この4次元関数を離散化してデジタル記録するためのデバイスです。

この膨大な光線情報を1枚のセンサーで捕捉するためのハードウェア的ブレイクスルーが、メインレンズとイメージセンサーの直前に微小なレンズ群を敷き詰めるマイクロレンズアレイ(Micro Lens Array: MLA)の導入です。このアーキテクチャはプレノプティックカメラと呼ばれます。メインレンズを通過した光束は、MLAによって入射角度ごとに微細に分離され、センサー上の異なるピクセル群(マクロピクセル)へと投影されます。

ここで立ちはだかるのが、「空間解像度と角度解像度の物理的トレードオフ」という光学的な壁です。限られたセンサーの総画素数を「画像のきめ細かさ(空間解像度)」と「奥行き精度を担保する視点数(角度解像度)」で分割しなければならないため、最終的な出力画像の解像度は元のセンサー画素数から劇的に低下します。さらに、マイクロレンズのピッチが極小化するにつれて、隣接するレンズ間での光の漏れ(クロストーク)や、光の回折限界による解像度低下といった光学的なノイズが顕著になります。これらの物理的制約をいかに光学設計と信号処理アルゴリズムで克服するかが、長きにわたりライトフィールド技術の最大の課題とされてきました。

競合技術との比較と市場動向の歴史的変遷

光線の「位置」と「方向」を同時に取得する仕組みは、光学技術の根底を覆すパラダイムシフトをもたらしましたが、その商業化の道のりは平坦ではありませんでした。本セクションでは、ライトフィールド技術がどのように市場を形成してきたのか、そして現代の主要な3D計測技術と比べてどのような優位性・劣位性を持つのかを解き明かします。

コンシューマー向けから産業特化へのシフト(Lytroの挫折とRaytrixの台頭)

ライトフィールド技術の商業化の歴史は、2010年代初頭にコンシューマー市場で熱狂を巻き起こした米Lytro(ライトロ)社の存在なしには語れません。同社は世界で初めて一般消費者向けにプレノプティックカメラを量産し、「撮影後にピントを合わせる」という驚きを提供しました。しかし、前述した「空間解像度の低下」という物理的トレードオフが致命傷となりました。当時のセンサー技術では出力される2D画像の解像度が数メガピクセル程度に留まり、急速にマルチカメラ化とAI画像補正(コンピュテーショナルフォトグラフィ)を進化させたスマートフォンのカメラ性能に太刀打ちできず、Lytroは市場からの撤退を余儀なくされました。

対照的に、この技術の真価を「産業用3D計測」に見出し、不動の地位を築いたのがドイツのRaytrix(レイトリックス)社です。彼らは「人間の鑑賞のための高画質写真」というコンシューマー的価値観を捨て、純粋な計測機器としての最適化に舵を切りました。Raytrixは、焦点距離の異なる3種類のマイクロレンズをヘキサゴナル(六角形)状に混在させる「マルチフォーカスMLA設計」という独自の特許技術を採用しました。これにより、被写界深度を標準カメラの数倍に拡張しつつ、アルゴリズムによる補間を用いて有効解像度の低下を最小限に抑えることに成功したのです。彼らのカメラは、微細な電子部品や移動する対象物を瞬時に3次元化する「ワンショット3D」のデファクトスタンダードとなっています。

LiDARやToF、ステレオカメラとの徹底比較

現在、産業界には多様な3D計測技術が存在しますが、それぞれに明確な得意・不得意があります。R&Dエンジニアがシステムを選定する際、ライトフィールドカメラが他の競合技術とどう異なるのかを正確に理解することは極めて重要です。

| 技術方式 | 動作原理 | メリット(得意領域) | デメリット(技術的落とし穴) |

|---|---|---|---|

| ライトフィールド(プレノプティック) | マイクロレンズアレイで光線の4次元情報をパッシブに取得 | ワンショットで動的対象の高精度3D化が可能。金属光沢や透明体、微小領域(マクロ〜顕微鏡)の計測に極めて強い。オクルージョン(死角)耐性が高い。 | データ量が膨大でリアルタイム処理に高価なGPUが必要。広域・長距離(数十メートル先)の計測には不向き。 |

| LiDAR(Time of Flight / FMCW) | レーザー光を照射し、反射波が戻るまでの時間や周波数変化を計測 | 屋外での長距離計測(自動運転など)に優れる。環境光(太陽光など)の影響を受けにくい。 | 空間分解能に限界があり、ミクロン単位の微小検査には不適。透明体や強い鏡面反射を伴う素材では計測が破綻しやすい。 |

| ステレオカメラ(多眼ビジョン) | 2つ以上のカメラ間の視差(三角測量)から深度を計算 | 低コストで導入可能。広範囲の人流検知やロボットの障害物検知に適する。 | テクスチャ(模様)のない単一色の平面や、反復パターンのある対象ではマッチングエラーを起こす。死角(オクルージョン)に弱い。 |

| 位相シフト法(構造化照明) | プロジェクタで特定の縞模様を投影し、その歪みから形状を算出 | 静止物に対しては極めて高い精度(サブミクロン)を誇り、リバースエンジニアリング等で主流。 | 複数回のパターン投影が必要なため、動いている対象物の計測が不可能。システムが大型化しやすい。 |

この比較から明らかなように、ライトフィールドカメラは「工場ラインを高速で流れる部品」「微細な基板のハンダ」「透明な接着剤」といった、既存技術が苦手としてきた領域において無類の強さを発揮します。

国内外の主要プレイヤーとコンポーネントレベルの特許戦略

ライトフィールド技術の市場は、完成品メーカーだけでなく、キーコンポーネントを握る巨大な光学・半導体メーカーの特許戦略によって牽引されています。

- Raytrix (独): 産業用プレノプティックカメラの王者。前述のマルチフォーカス技術を武器に、半導体パッケージのインライン検査やPIV(粒子画像流速測定法)分野で圧倒的シェアを持ちます。

- ソニー (日): 世界トップのCMOSイメージセンサーシェアを背景に、センサーの受光面とマイクロレンズアレイをナノレベルで統合する「オンチップMLA」の特許を多数保有。メタバース空間を記録するための次世代エッジデバイスや、自動運転におけるLiDARを補完する高精細ビジョンセンサーとしての実装を模索しています。

- キヤノン (日): 一眼レフ等で培った「デュアルピクセルCMOS AF」技術の延長線上にライトフィールドの概念を置いています。1つの画素を分割し、微小な視差情報(位相差)を取得する特許群を展開しており、産業用ロボットビジョンや医療用内視鏡の高度化において強い技術的優位性を築いています。

- 空間コンピューティング系スタートアップ: ハードウェアそのものの開発からは一歩引き、取得された多視点データからリアルタイムで空間を再構築するクラウドベースのAIソフトウェア・パイプラインの構築に注力する企業が急増しています。

産業界で加速する実用化:3D計測、外観検査、そして極微から流体まで

ライトフィールド技術は現在、製造業の現場や最先端の研究開発(R&D)において、従来の光学システムでは突破できなかったボトルネックを次々と解消しています。空間の「光のベクトル」を一度に捉えるという特性が、どのように産業的な価値に変換されているのかを詳解します。

製造業R&Dにおける「ワンショット3D」の圧倒的威力と導入のハードル

インダストリー4.0の推進に伴い、製造ラインではタクトタイム(製造工程の所要時間)を落とすことなく、ミクロン単位の全数3D検査を行うことが求められています。ここで活躍するのが産業用プレノプティックカメラによる「ワンショット3D」技術です。従来の位相シフト法(構造化照明)は複数回の撮影が必要なため対象物を静止させる必要がありましたが、ライトフィールドカメラは1回のフラッシュ露光(マイクロ秒単位)で高解像度2D画像と高精度な深度マップを同時に取得します。コンベア上を高速で移動する対象物であっても、ブレのない3次元形状を取得できるのです。

特にブレイクスルーとなっているのが、透明素材や高反射素材の検査です。金属削り出し部品の鏡面や、スマートフォンのディスプレイガラス、透明なUV硬化樹脂ボンドなどは、レーザー変位計やステレオカメラでは光が乱反射・透過してしまい正確な計測が困難でした。しかし、プレノプティックカメラはマイクロレンズアレイによる「多数の微小な異なる視点」を同時に持っているため、特定の視点での強い反射(ハレーション)をアルゴリズムで排除し、正しい表面形状を再構築することが可能です。また、突起物の裏側に生じる死角(オクルージョン)も、多視点からの回り込みによって大幅に低減されます。

ただし、「実用化における導入のハードル」を無視することはできません。マイクロレンズアレイとイメージセンサーは数ミクロンの精度で精密にアライメント(位置合わせ)されています。工場内の急激な温度変化や激しい振動によって生じるわずかな熱膨張・歪みは、光学的なキャリブレーション(校正)を狂わせ、深度計算に致命的な誤差をもたらします。そのため、産業用ハイエンドモデルでは、筐体の徹底した熱対策と、ソフトウェアによるリアルタイムの自己校正アルゴリズムの実装が必要不可欠となっています。

気流・熱流体解析(PIV)から微小空間の顕微鏡計測まで

ライトフィールドカメラの応用は、固体の外観検査にとどまりません。流体力学、燃焼工学、バイオサイエンスといった極めて高度な動的現象の観測において、革命的な計測手法を提供しています。

航空宇宙産業や自動車エンジンの開発現場では、気流や燃料噴射の挙動を解析するために「トモグラフィックPIV(粒子画像流速測定法)」と呼ばれる手法が用いられてきました。従来は対象物を囲むように3〜6台のハイスピードカメラを厳密に同期・校正して撮影する必要がありました。しかし、ライトフィールドカメラを導入することで、単一のカメラウィンドウから空間内のトレーサー粒子の3次元的な動き(x, y, zの速度ベクトル)を一括して計測できる「3D PTV(3次元粒子追跡流速計)」が実現しました。燃焼室内の複雑な火炎の渦や、タービンブレード周辺のマイクロ秒単位の流体変化を、コンパクトな機材構成で可視化できるようになったのです。

さらに、医療・バイオ分野では既存の光学顕微鏡のカメラポートにプレノプティックカメラを接続するアプローチが普及しつつあります。従来の共焦点レーザー顕微鏡は、Z軸(奥行き)方向に焦点を機械的にスキャンしていくため、生きた細胞の動きなど、高速な動的変化を3Dで捉えることが困難でした。ライトフィールド顕微鏡は、一度の露光で微小空間のボリュームデータを取得できるため、神経細胞の活動電位の3Dトラッキングや、血流中の微小な細胞の動きをリアルタイムかつ非破壊で観察する「神の目」として機能しています。

【TechShift独自考察】最新AI(NeRF/3DGS)との融合が描く未来シナリオ

これまで解説したように、マイクロレンズアレイという物理的なハードウェアを用いたライトフィールド技術は、計測の領域で確固たる実績を積んできました。しかし現在、テクノロジーの最前線では、この物理デバイスと最新の生成AIが劇的な融合を果たし、新たな次元へと突入しています。本セクションでは、空間コンピューティング時代を決定づける最重要トレンドを深掘りします。

計算機合成写真術と最新AIがもたらすパラダイムシフト

近年、コンピュータビジョンとAIの分野において世界的な熱狂を生んでいるのが、NeRF(Neural Radiance Fields:神経放射輝度場)や3D Gaussian Splatting(3DGS)に代表される「自由視点画像生成技術」です。これらは、限られた視点から撮影された2D画像群を入力として、空間内の光の振る舞い(プレノプティック関数)を深層学習モデルのネットワーク内に暗黙的に記憶させ、未知の視点からの超高精細な3D映像をリアルタイムにレンダリングする技術です。

ここで重要なのは、NeRFや3DGSが極めて高い精度を発揮するためには「被写体を様々な角度から撮影した、膨大かつ緻密な位置情報付きの画像データ(教師データ)」が必要だということです。従来の単眼カメラでこのデータを収集するには、対象物の周囲を何周も歩き回って撮影するか、巨大なマルチカメラリグを組む必要がありました。しかし、ライトフィールドカメラが取得する「光線の方向情報が含まれた密な4次元データ」は、まさにこれらのAIが最も渇望しているグラウンドトゥルース(究極の正解データ)そのものなのです。

ライトフィールドカメラの「ワンショット3D」取得能力と、AIの「空間補間・超解像能力」は、最高に相性の良い補完関係にあります。ハードウェア単体では限界があった「空間解像度の低下」という弱点を、AIが学習を通じてフォトリアルに補完・復元します。逆にAI単体では困難だった「高速に動く被写体(動的シーン)の即座な空間学習」を、ライトフィールドカメラがワンショットで提供します。このハードとソフトの融合により、これまで不可能とされてきた「動的シーンにおけるリアルタイムの高解像度4D空間(3D+時間)の再構築」が、現実のものとなりつつあります。

2026〜2030年の予測シナリオ:空間コンピューティング時代の中核へ

この「ライトフィールドカメラ × 空間生成AI」の融合は、向こう3〜5年でビジネスエコシステムに数千億円規模のインパクトをもたらすとTechShiftは予測します。具体的に以下のようなシナリオが進行していくと考えられます。

- 超小型化と「メタレンズ(Metalens)」との融合:

現在、半導体製造技術(ナノインプリント等)の進化により、従来のガラスレンズの代わりにナノ構造体で光を制御する「メタレンズ」の実用化が急ピッチで進んでいます。これをマイクロレンズアレイの代わりとしてイメージセンサー直上に集積することで、従来の光学系が抱えていた収差やクロストークを根本から排除した、紙のように薄く、かつ超高解像度な次世代プレノプティックセンサーが誕生します。 - 次世代自律移動ロボットと高度医療機器への標準搭載:

工場内を自律走行するAMR(自律型搬送ロボット)や、ドローン、ヒューマノイドロボットの「目」として、ライトフィールドセンサーとエッジAIチップを統合したモジュールの搭載が進みます。また、医療分野においては「ダヴィンチ」に代表されるロボット支援手術の内視鏡にライトフィールド技術が組み込まれ、執刀医に対し臓器の深度情報や隠れた血管の位置をAR(拡張現実)としてリアルタイムに重畳表示するシステムが普及するでしょう。 - メタバース空間の完全自動生成パイプライン:

Apple Vision ProやMeta QuestなどのXRデバイスが普及期を迎える中、現実空間のフォトリアルな3Dアセット(デジタルツイン)をいかに低コストで大量生成するかが最大の課題となっています。ライトフィールド技術を搭載したスマートフォンやポータブルデバイスで対象物を「一瞬かざす」だけで、クラウド上のAIが即座に軽量な3Dモデル(3DGSデータなど)を生成・共有するパイプラインが確立され、メタバースの構築コストは現在の10分の1以下に圧縮されます。

ライトフィールドカメラを「単なる特殊なレンズを持ったハードウェア」として評価するフェーズはすでに過去のものです。現在は、物理空間の究極の光情報を取得するエッジデバイスとして、そして空間コンピューティングを駆動する巨大なAIモデルの「最良のインプット装置」として再定義されています。このハードウェアとソフトウェアの不可分な結びつきをいち早く自社の技術戦略に組み込んだプレイヤーこそが、次の10年の産業競争を制することは間違いありません。

よくある質問(FAQ)

Q. ライトフィールドカメラと普通のカメラの違いは何ですか?

A. 普通のカメラが現実空間を2次元の平面として記録するのに対し、ライトフィールドカメラは空間を飛び交う光の「ベクトル情報」を記録します。これにより、撮影後でも自由にピントを合わせ直す(リフォーカス)ことや、一度のシャッターで精緻な3次元空間を再構築することが可能です。

Q. ライトフィールドカメラは現在何に使われていますか?

A. かつては消費者向けに展開されましたが、現在は主に産業分野の最先端3D計測インフラとして実用化されています。一度の撮影で立体を把握できる強みを活かし、製造業での外観検査や高度な3D計測、気流・熱流体解析(PIV)、さらには微小空間の顕微鏡計測などに活用されています。

Q. ライトフィールドカメラとLiDARの違いは何ですか?

A. どちらも3次元空間の計測に用いられますが、取得手法が異なります。LiDARがレーザーを照射し反射時間を測定して距離を測るのに対し、ライトフィールドカメラは特殊な光学設計により空間の光線の進行方向と強度を取り込み、計算によって立体を構築します。そのため、ワンショットで瞬時に高精度な3D情報を取得できるのが特徴です。