現代のデジタルビジネスにおいて、データは単なる記録ではなく、企業の競争優位性を決定づける中核資産です。しかし、データの爆発的な増加と生成AIの急速な台頭により、これまでのデータアーキテクチャは明らかな限界を露呈し始めました。構造化データを正確に分析する「データウェアハウス(DWH)」と、大量の生データを無秩序に蓄積する「データレイク」。この二極化された基盤を並行稼働させる従来のアプローチは、複雑なデータ連携(ETL)によるタイムラグやコスト増大、そして「どのデータが真実か」という整合性の崩壊を引き起こしています。

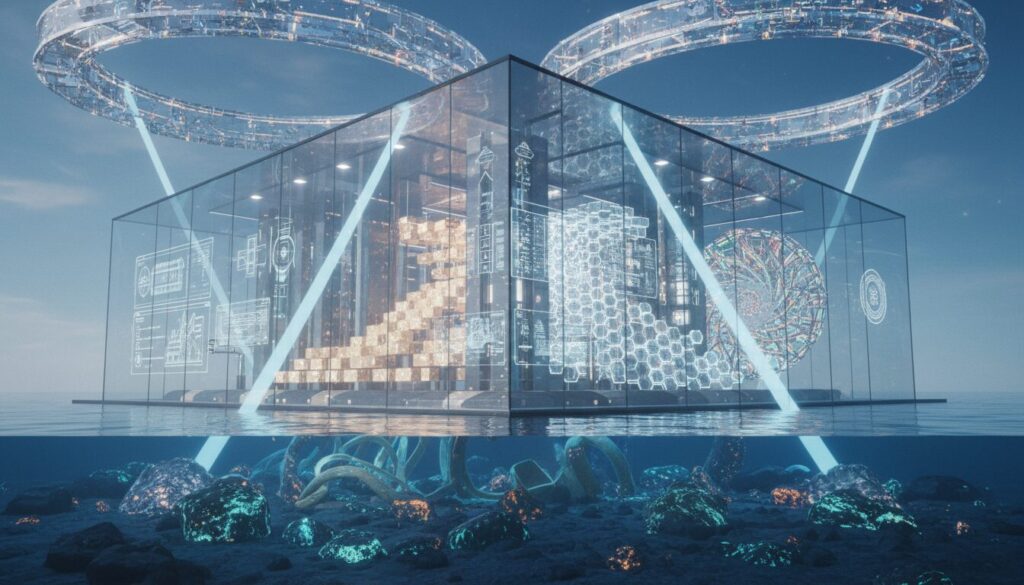

これらの課題を根本から解決し、ビジネスインテリジェンス(BI)と人工知能(AI/ML)のワークロードを単一のプラットフォーム上でシームレスに統合する次世代アーキテクチャが「データレイクハウス」です。本記事では、テクノロジー専門メディア「TechShift」の視点から、データレイクハウスの技術的深淵、DWHやデータレイクとの決定的な違い、主要ベンダーの最新動向、そして2030年を見据えたデータ戦略の未来像までを網羅的かつ圧倒的な解像度で解説します。

- 1. データレイクハウスとは?次世代データ基盤が求められる背景

- 1.1. DWHとデータレイクの限界:なぜ二者択一では不十分か

- 1.2. データレイクハウスの定義とアーキテクチャの進化

- 2. DWH・データレイク・データレイクハウスの徹底比較

- 2.1. 3つのアーキテクチャの特性比較(マトリクス解説)

- 2.2. コスト・パフォーマンス・ガバナンスにおける優位性

- 2.3. 技術的な落とし穴と実用化の課題

- 3. データレイクハウスを実現する中核テクノロジー

- 3.1. コンピュートとストレージの完全分離

- 3.2. ACID準拠を可能にするオープンテーブルフォーマット(Iceberg, Delta Lake, Hudi)

- 3.3. クエリエンジンの進化とマルチエンジン・アーキテクチャ

- 4. 主要ソリューションの徹底比較とベンダーロックインの現実

- 4.1. 各ベンダーのアーキテクチャ設計と思想の違い

- 4.2. メタデータカタログの覇権争い(Unity Catalog vs Polaris Catalog)

- 4.3. 自社のユースケースに最適なプラットフォームの選び方

- 5. AIとBIを統合するデータレイクハウスのビジネスインパクト

- 5.1. データサイエンス(AI/ML)とBIのサイロ化解消

- 5.2. LLM・生成AI(RAG)を支える次世代バックエンドとしての価値

- 5.3. 統合データガバナンスの実現とFinOpsによるコスト最適化

- 6. 導入に向けた実践ロードマップと未来予測

- 6.1. 既存システムからの段階的な移行ベストプラクティス

- 6.2. レイクハウス時代に求められるデータ組織の再構築

- 6.3. 2026〜2030年の予測シナリオ:データ基盤はどう進化するのか

1. データレイクハウスとは?次世代データ基盤が求められる背景

現代のデータドリブン経営において、CTOやデータアーキテクトが直面する最大のボトルネックは「データ基盤のサイロ化と二重管理」です。かつてエンタープライズの現場では、用途に応じて2つの異なるデータ基盤を構築することが最適解とされてきました。しかし、あらゆるデータがリアルタイムに生成され、AIのモデル学習に即座に供給されなければならない現在、このアーキテクチャは致命的な遅れを生み出しています。

1.1. DWHとデータレイクの限界:なぜ二者択一では不十分か

企業のデータ活用が高度化する中、「精緻なBIレポーティング」と「予測モデル構築や生成AI開発のためのAI/ML」という2つの要件を単一のアーキテクチャで満たすことは長年の課題でした。従来のデータ基盤では、目的別に環境を使い分ける「2層ハイブリッド(並行稼働)」構成が一般的でしたが、この運用はデータエンジニアリングにおいて以下のような深刻な限界をもたらしています。

- データコピーのオーバーヘッドと整合性の欠如(Data Gravityの問題):データレイクに蓄積されたペタバイト級の生データを、複雑なETL処理を経てDWHへコピーするアーキテクチャでは、データ移動そのものが膨大なインフラ負荷とレイテンシを生みます。結果として「データサイエンティストがモデル学習に使うデータ」と「経営陣がダッシュボードで見る数値」にタイムラグとズレが生じ、SSOT(信頼できる唯一の情報源)の確立が破綻します。

- ガバナンスとセキュリティモデルの分断:DWHが備える行・列レベルの堅牢なアクセス制御と、データレイクのファイルベースのアクセス権限を二重に管理することは、情報漏洩リスクと運用監査のコストを指数関数的に増大させます。

- 非構造化データへの非対応とAI/MLの遅れ:DWHは表形式の構造化データには強いものの、画像、音声、自然言語のテキストファイルといった非構造化・半構造化データの扱いに極めて弱く、現在主流となっているLLM(大規模言語モデル)やマルチモーダルAIの実装基盤としては不適格です。

データアーキテクチャの進化と、それぞれの世代が直面した「限界」を以下の表に整理しました。

| アーキテクチャ | 中核となる強みと得意領域 | 直面した致命的な限界(ビジネスインパクト) |

|---|---|---|

| データウェアハウス(第1世代) | 構造化データの高速集計、厳格なスキーマ、ミリ秒単位のBI連携。 | 非構造化データの処理不可。データ量の爆発に伴うコンピュート・ストレージ一体型による莫大なインフラ投資コストの発生。 |

| データレイク(第2世代) | 大容量・多様なデータの低コスト保存、AI/ML探索環境の提供。 | ACIDトランザクションの欠如によるデータ更新・削除時の不整合。ガバナンス不足による「データスワンプ(データの沼)」化。 |

| 2層ハイブリッド(並行稼働) | BIとAI/MLそれぞれの要件を分離して満たす。 | ETLパイプラインの複雑化、ストレージの二重課金によるTCO悪化、エンジニアがパイプライン保守に忙殺される技術的負債。 |

1.2. データレイクハウスの定義とアーキテクチャの進化

これらの限界を打ち破るべく登場したのが、データレイクハウスです。基礎的な定義としては、「データレイクの柔軟性・スケーラビリティ・低コストなオブジェクトストレージ層の上に、データウェアハウスの高度なデータ管理機能(スキーマ強制、タイムトラベル、ACIDトランザクションなど)を直接実装したオープンなアーキテクチャ」となります。

しかし、これは単なる「概念の掛け合わせ」にとどまりません。実務レベルでの最大のイノベーションは、コンピュート(計算処理)とストレージ(データ保存)の分離を極限まで推し進めつつ、その中間に存在する「メタデータ管理とテーブルフォーマット」をオープン標準化した点にあります。

安価なクラウドストレージ(Amazon S3やGoogle Cloud Storageなど)上の単一のデータ実体に対して、BIツールのための高速なSQLクエリエンジンと、AI/MLのためのPythonやSparkによる分散処理エンジンが、互いに干渉することなく同時にアクセス可能になります。このパラダイムシフトにより、データエンジニアリングのリソースは「ETL(データ移動)という負債」から解放され、高度なAIアルゴリズムの開発やデータモデリングへと投資されるようになります。

2. DWH・データレイク・データレイクハウスの徹底比較

データ基盤のモダナイゼーションを検討する際、「DWHのパフォーマンスを取るか、データレイクのコストメリットを取るか」という妥協は完全に過去のものとなりました。ここでは、自社のデータ基盤を次世代へアップデートするための判断材料として、3つのアーキテクチャの明確な違いを深掘りします。

2.1. 3つのアーキテクチャの特性比較(マトリクス解説)

以下の表は、各アーキテクチャがエンタープライズの現場でどのような挙動とコスト構造を持つかを定量・定性的に整理したものです。

| 比較項目 | データウェアハウス(DWH) | データレイク | データレイクハウス |

|---|---|---|---|

| データ型と構造 | 構造化データ(厳格な事前定義スキーマ) | すべてのデータ(スキーマオンリード) | すべてのデータ(柔軟なスキーマ進化・強制) |

| パフォーマンス | 非常に高い(インデックスと最適化が強力) | 低い〜中程度(スキャン量に依存) | 高い(DWHと同等の高度なクエリ最適化) |

| コストモデル | 高額(ストレージ・コンピュート密結合) | 安価(低コストなオブジェクトストレージ) | 最適化(コンピュートとストレージの完全分離) |

| 品質とトランザクション | 完全なACID保証 | 保証なし。不整合リスク大 | 完全なACID保証、タイムトラベル対応 |

2.2. コスト・パフォーマンス・ガバナンスにおける優位性

エンタープライズ企業がレイクハウスへの移行を急ぐ背景には、極めて現実的な経営課題の解決があります。

- コピーレス・アーキテクチャによるSSOTの確立:従来はデータレイクからDWHへデータを転送するETLが不可欠でした。レイクハウスでは、あらゆるシステムが同一のストレージデータを直接参照するため、分析結果のズレが解消され、パイプラインの運用保守コスト(FinOps観点)が劇的に低下します。

- ベンダーロックインの排除とアジリティ:プロプライエタリ(独自仕様)なDWHフォーマットに縛られることなく、オープンフォーマットでデータを保持できるため、将来的により優れたAI分析エンジンが登場した際も、データを移行することなく即座にツールを乗り換えることが可能です。

2.3. 技術的な落とし穴と実用化の課題

しかし、データレイクハウスは導入すれば全てが解決する「魔法の杖」ではありません。実用化にあたっては、以下の高度な技術的課題(落とし穴)を理解し、適切に運用設計を行う必要があります。

- スモールファイル問題とコンパクションの負荷:クラウドのオブジェクトストレージは追記や部分更新に弱いため、IcebergやDelta Lakeは更新があるたびに新しい差分ファイルを生成します。これが蓄積すると、無数の小さなファイルが乱立し、クエリ実行時のネットワークI/Oやリスティング処理のオーバーヘッドが致命的に悪化します。これを防ぐため、定期的に小ファイルを結合する「コンパクション(最適化バキューム処理)」のジョブをバックグラウンドで走らせる必要があります。

- オプティマイザと統計情報の管理:従来のDWHはベンダーが自動で高度なインデックスチューニングを行ってくれましたが、レイクハウスではZ-Ordering(多次元クラスタリング)やパーティション設計を自前で適切に行わないと、全件スキャンが発生しパフォーマンスが出ません。

- クラウドAPIのコール制限とコスト:S3やGCSに対する過剰なGET/LISTリクエストは、ストレージ保存費用とは別に多額のAPI利用料金を発生させるリスクがあります。メタデータキャッシュ戦略の構築が不可欠です。

3. データレイクハウスを実現する中核テクノロジー

AI/MLのワークロードとBIのクエリを単一のプラットフォームで処理するこの革新は、緻密に設計されたブレイクスルー技術によって支えられています。本セクションでは、その心臓部を解剖します。

3.1. コンピュートとストレージの完全分離

従来のDWHにおける最大のコスト要因は、演算リソース(CPU/メモリ)とストレージがアーキテクチャレベルで密結合していたことでした。データ量が増えれば、計算能力が不要であっても高価なノードを追加(スケールアウト)しなければなりません。

データレイクハウスでは、これを完全に分離します。最下層に安価なクラウドオブジェクトストレージを配置し、その上の独立したレイヤーで演算エンジンを動的にスケーリングさせます。これにより、データサイエンティストがPySparkで重い深層学習モデルのトレーニングを行っている全く同じデータセットに対し、ビジネスアナリストがBIツールからクエリを実行しても、リソースの競合やパフォーマンスの劣化が一切発生しません。

3.2. ACID準拠を可能にするオープンテーブルフォーマット(Iceberg, Delta Lake, Hudi)

分離されたストレージに対して、DWHと同等の堅牢なデータ制御をもたらすのが「オープンテーブルフォーマット」です。Parquet等の列指向ファイルの上にメタデータ管理レイヤーを構築することで、ペタバイト級のデータに対する安全なINSERT / UPDATE / DELETE操作や、スキーマ進化(列の追加・削除)、タイムトラベルを実現します。現在、デファクトスタンダードを争う3つの主要技術が存在します。

- Apache Iceberg:Netflix発祥。特定エンジンに依存しない中立的な設計で、ディレクトリのリスティングを不要にするマニフェストファイル階層構造が特徴。超大規模データのクエリパフォーマンスに圧倒的な強みを持ちます。

- Delta Lake:Databricks主導。JSONベースのトランザクションログを持ち、Apache Sparkエコシステムとの極めて深いネイティブ統合により、機械学習パイプラインの構築に優れます。

- Apache Hudi:Uber発祥。リアルタイムのストリーミングデータの取り込みと、レコードレベルの増分処理(Upsert)に特化しています。

これらのフォーマットは、更新戦略として「Copy-on-Write(CoW)」(更新時にファイル全体を書き直し、読み取りを最速化するBI向け戦略)と、「Merge-on-Read(MoR)」(差分のみを書き出し、クエリ実行時にマージするストリーミング向け戦略)を選択でき、ワークロードに応じた緻密なチューニングが可能です。

3.3. クエリエンジンの進化とマルチエンジン・アーキテクチャ

フォーマットのオープン化に伴い、クエリエンジン側も劇的な進化を遂げています。C++やRustで記述されたベクトル化クエリエンジン(DatabricksのPhotonエンジンなど)は、ハードウェアのSIMD命令を直接叩くことで、オブジェクトストレージ上のデータであっても従来のDWHに匹敵、あるいは凌駕する処理速度を叩き出します。

さらに、Trino(旧PrestoSQL)のような分散SQLエンジンを用いれば、複雑なデータ移動なしに、アドホック分析はTrinoで、大規模なデータ変換バッチはSparkで実行するといった「適材適所のマルチエンジン構成」が容易に実現できます。

4. 主要ソリューションの徹底比較とベンダーロックインの現実

データレイクハウスの理想形を実装するアプローチは、各プラットフォーマーの歴史的背景や製品哲学によって大きく異なります。ここでは、主要プレーヤーの戦略を紐解きます。

4.1. 各ベンダーのアーキテクチャ設計と思想の違い

- Databricks(AI/MLファースト):レイクハウス概念の提唱者であり、Delta Lakeを中核に据えています。ノートブック環境から高度なMLOpsまでが統合されており、データサイエンスとエンジニアリングの協業を最速化するトップダウン・アプローチです。

- Snowflake(クラウドDWHからの進化):元来クラウドDWHの王者ですが、近年「Iceberg Tables」をネイティブサポートし、データの実体をSnowflakeの外部(S3等)に置いたまま強力なクエリエンジンとガバナンス機能を提供する戦略に大きく舵を切りました。

- AWS / Google Cloud(既存インフラ拡張型):AWSはRedshiftの計算能力をS3上のIcebergへ透過的に拡張。Google Cloudは「BigLake」を通じて、BigQueryの強大なエンジンとセキュリティモデルをオープンフォーマットに拡張し、マルチクラウド対応のSSOT確立を強力に推し進めています。

- IBM watsonx.data(オープン・マルチエンジン型):ストレージにApache Icebergを標準採用し、PrestoやSparkといった複数エンジンをワークロードに応じて動的に切り替えるハイブリッドクラウド統合の最前線ソリューションです。

4.2. メタデータカタログの覇権争い(Unity Catalog vs Polaris Catalog)

データフォーマットのオープン化が進んだ現在、ベンダー各社の次なる主戦場は「メタデータ・カタログ」と「ガバナンスレイヤー」の覇権争いへと移行しています。データ本体が特定のベンダーから解放されたとしても、アクセス権限やデータ辞書を管理するカタログがクローズドであれば、実質的なベンダーロックインは解消されません。

この危機感から、Databricksは自社の強力なガバナンスツールであるUnity Catalogをオープンソース化し、レイクハウス上のあらゆるデータ資産・AIモデルの権限を統合管理する業界標準を目指しています。対抗するSnowflakeもオープンソースのPolaris Catalogを発表し、Icebergエコシステムの囲い込みを防ぐ構えを見せています。これらの「カタログ標準化戦争」の動向は、企業が真のマルチクラウド戦略を描く上で極めて重要なファクターとなります。

4.3. 自社のユースケースに最適なプラットフォームの選び方

意思決定者が着目すべきは、「全社的なSSOTを維持しながら、自社の開発チームのスキルセットに最も適合するエコシステムはどれか」という点です。

- 生成AIや高度な機械学習モデルの内製開発が中心の組織であれば、MLOpsがネイティブ統合されたDatabricks。

- 既存の膨大なSQL資産とBIアナリストの業務フローを一切壊さずにレイクハウスの恩恵を受けたい場合は、Snowflake(Iceberg統合)やBigLake。

- コンピュートコストの極限までの最適化と、オンプレミスを含む複雑なハイブリッド環境の統合を目指すならwatsonx.data。

5. AIとBIを統合するデータレイクハウスのビジネスインパクト

データレイクハウスは、単なるITインフラのコスト削減策ではありません。組織全体の意思決定スピードを劇的に引き上げるビジネスドライバーです。

5.1. データサイエンス(AI/ML)とBIのサイロ化解消

これまで、データエンジニアはDWHへ構造化データを送り、データサイエンティストにはデータレイクの生データを提供するという、複雑な二重パイプライン運用を強いられていました。レイクハウスの導入により、データサイエンティストが開発した機械学習モデルの予測結果をデータレイク上の同一テーブルに即座に書き込み、それを経営陣やアナリストがBIダッシュボードで遅延なく可視化するサイクルが完成します。ECサイトにおける「過去の購買履歴」と「リアルタイムのクリックストリーム」を組み合わせた超パーソナライズ・レコメンドなどが、単一基盤で実現します。

5.2. LLM・生成AI(RAG)を支える次世代バックエンドとしての価値

従来のDWHでは、PDF文書や画像・音声ログといった非構造化データは分析対象外として放置され「データスワンプ」化することが常態化していました。しかし、レイクハウスでは非構造化データに対しても高度なメタデータ付与とバージョン管理が可能です。

現在、最先端の企業はレイクハウス上に自社のドキュメント群やベクトルエンベディング(テキストの埋め込み表現)を直接保持し、大規模言語モデル(LLM)と連携させたRAG(検索拡張生成:Retrieval-Augmented Generation)のバックエンド基盤として活用し始めています。社内規程や顧客対話ログに基づく高精度な生成AIアプリケーションが、基幹システムの厳格なセキュリティポリシーを維持したままシームレスに構築可能となるのです。

5.3. 統合データガバナンスの実現とFinOpsによるコスト最適化

データが複製されるたびに増大していたストレージコストとライセンス費用は、コンピュートとストレージの分離によって底値まで抑制されます。さらに、FinOps(クラウドコスト最適化)の観点において、「クエリを実行したい時だけコンピュートリソースをスピンアップさせる」従量課金モデルは、高価なDWHの常時稼働コストを劇的に削減します。また、ハイブリッドクラウド下に点在するペタバイト級のデータに対して、単一のコントロールプレーンから行・列レベルのマスキングやアクセス制御を適用できるため、コンプライアンスリスクも最小化されます。

6. 導入に向けた実践ロードマップと未来予測

レイクハウスへの移行は「ビッグバン・マイグレーション(全システムの一斉入れ替え)」ではなく、業務影響を抑えた段階的なアプローチが推奨されます。

6.1. 既存システムからの段階的な移行ベストプラクティス

自社の既存アーキテクチャの重心に応じて、以下の2つのアプローチから選択します。

- Inside-out アプローチ(データレイク主導):既存のS3やGCS上の生データに対して、IcebergやDelta Lakeのフォーマットを被せる手法。既存の非構造化データ資産を活かしつつ、即座にクエリ性能を向上させます。

- Outside-in アプローチ(DWH主導):既存のSnowflakeやBigQueryの外部テーブル機能を活用し、DWH側からデータレイク内のオープンフォーマットを直接クエリする構成。稼働中のBIパイプラインを破壊せず、段階的にデータをストレージ層へオフロード(移行)していく堅実な手法です。

6.2. レイクハウス時代に求められるデータ組織の再構築

アーキテクチャが進化しても、組織がサイロ化したままではROIは半減します。レイクハウスの恩恵を最大化するには、「データメッシュ」的な思考を取り入れた組織のアップデートが不可欠です。

中央の「プラットフォームエンジニアリングチーム」は、Iceberg等を用いた共通ストレージ層とガバナンスの提供に専念します。一方、各事業ドメインのチームは、提供された単一のデータソース(SSOT)に対して、自分たちの用途に合ったコンピュートエンジン(SQLやPython)を自由に選択し、自己組織化された「データプロダクトオーナー」としてインサイトを創出する体制へと移行すべきです。

6.3. 2026〜2030年の予測シナリオ:データ基盤はどう進化するのか

最後に、今後のデータレイクハウスを取り巻く技術トレンドの未来像を提示します。

- ユニバーサルフォーマットによる「フォーマット戦争」の終結:現在Delta、Iceberg、Hudiの間で起きている主導権争いは、Apache XTable(旧 OneTable)のような相互運用レイヤーの台頭により無意味になります。メタデータのみを動的に変換し、単一のデータ実体で全フォーマットのエコシステムに同時対応する世界が到来します。

- AIドリブンな自律型データ管理:データベースのインデックス作成、パーティショニング、そして複雑なコンパクション処理自体を、LLMベースのAIエージェントがワークロードを常時監視し、人間を介さずに自律的かつ自動で最適化する「Zero-Ops」の時代に突入します。

- ストリーミング・ファースト・レイクハウスの標準化:バッチ処理とストリーミングの境界が完全に消滅します。KafkaやFlink経由でリアルタイムに流入するストリームデータがミリ秒単位でレイクハウスに反映(Upsert)され、即座に生成AIのコンテキストとして活用される超低遅延アーキテクチャがエンタープライズの標準となるでしょう。

データレイクハウスは、テクノロジーの純粋な進化であると同時に、企業を真のデータ・AI駆動型組織へとパラダイムシフトさせる強制的な触媒です。データに対する深い理解と適切なプラットフォーム戦略の選定こそが、次代のビジネスにおける圧倒的な競争優位性を生み出します。

よくある質問(FAQ)

Q. データレイクハウスとは何ですか?

A. データレイクハウスは、ビジネスインテリジェンス(BI)とAI・機械学習の処理を単一のプラットフォーム上でシームレスに統合する次世代のデータ基盤です。正確な分析を行う「データウェアハウス」と、大量の生データを蓄積する「データレイク」の利点を兼ね備えています。これにより、データの整合性を保ちながら高度なデータ活用を可能にします。

Q. データレイクハウスとDWH・データレイクの違いは何ですか?

A. DWHは構造化データの分析に特化し、データレイクは多様な生データを無秩序に蓄積します。一方データレイクハウスは、これら2つの基盤を完全に統合したアーキテクチャです。従来のように両者を並行稼働させる際の複雑なデータ連携(ETL)やタイムラグ、コスト増大といった課題を根本から解決できる点が決定的な違いです。

Q. データレイクハウスを実現する技術や仕組みは何ですか?

A. 主に「コンピュートとストレージの完全分離」や、マルチエンジン・アーキテクチャの進化が中核を担います。さらに、IcebergやDelta Lake、Hudiといった「オープンテーブルフォーマット」を採用しています。これにより、データレイク上にACIDトランザクションの準拠をもたらし、高いガバナンスと正確なデータ処理を実現しています。